Anthropic今年的节奏依然凶猛,几乎每隔一天就有新动作落地。而就在刚刚,万众期待的Claude Opus4.7正式发布。有意思的是,Anthropic在公告里直接坦言:「这并非我们最强大的模型。」那个传说中更强的Claude Mythos Preview依然按兵不动。但即便如此,Opus4.7依旧引发了极大关注——因为它解决的不是「更聪明」的问题,而是「更靠谱」的问题。

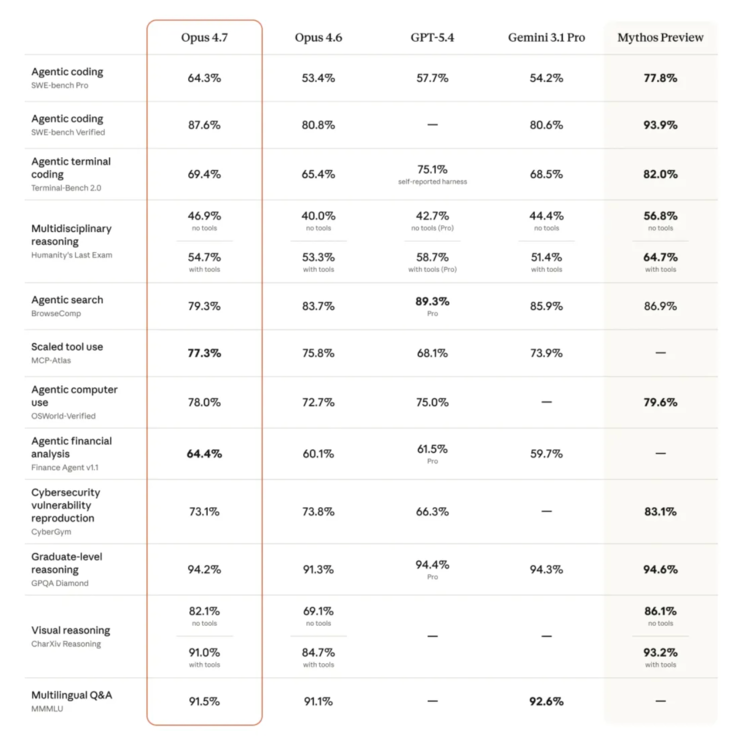

跑分层面,成绩相当亮眼。 在硬核编程基准SWE-bench Pro上,4.7从前代的53.4%跃升至64.3%,单代涨幅近11个百分点,将GPT-5.4(57.7%)和Gemini3.1Pro(54.2%)双双甩在身后。视觉推理基准CharXiv从69.1%跳至82.1%,背后是新增的2576像素长边识别能力,清晰度较前代提升3倍以上。工具调用评测MCP-Atlas上跑出77.3%,法律AI平台Harvey的BigLaw基准更拿下90.9%。不过在Agentic搜索评测BrowseComp上,4.7从83.7%小幅回落至79.3%,被GPT-5.4和Gemini反超——但这恰恰是它「不肯乱编答案」的性格使然,遇到缺失信息宁可报错也不凑数。

数字之外,更值得关注的是它的「气质」变化。 Replit负责人在测试后直言:「它会在技术讨论中反驳我,帮我做出更好的决定,真的像一个更好的同事。」数据科学平台Hex也发现,4.7遇到缺失数据会直接报错,而非像前代那样塞一个「看似合理但完全错误」的备选值。与此同时,任务韧性也大幅提升——Notion团队测试显示,工具错误率降至原来的三分之一,遇到工具链崩溃时能自己绕过障碍继续跑完任务。Vercel甚至发现了一个全新行为:4.7会在动手写系统级代码之前,先自己做数学证明。

当然,变强是有代价的。4.7引入了全新分词器,同样的文本会产生比原来多1到1.35倍的Token。加之它在复杂任务中本就倾向于「多想一会儿」,实际消耗几乎必然上升。为此,Anthropic新增了xhigh超高级别的思考强度,Claude Code已将所有套餐默认拉至该档位,同时推出深度审查指令/ultrareview、面向Max用户的Auto Mode扩展,以及帮助开发者管控Token支出的「任务预算」功能公测版。

而那个更强的Mythos Preview,本月刚以「Project Glasswing」的名义小范围开放给企业用于网络安全研究,因能力过强、安全评估尚未完成,暂不公开发布。

今天的4.7,是Anthropic高频交付节奏下最新的一块压舱石。而Mythos迟早会来——到那时,现在看起来已经很能打的4.7,或许只是个开端。