阿里巴巴千问大模型团队于2026年4月16日正式开源稀疏混合专家(MoE)模型 Qwen3.6-35B-A3B,标志着轻量级模型在智能体编程领域实现关键突破。

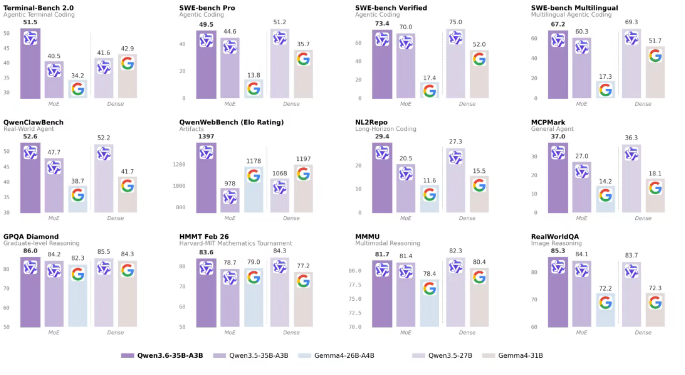

该模型总参数量为350亿,得益于MoE架构的稀疏特性,其运行时的激活参数仅为30亿。在性能表现上,Qwen3.6-35B-A3B 以极低的计算成本,在多项核心编程基准测试中超越了拥有270亿参数的稠密模型 Qwen3.5-27B,并显著领先于前代 Qwen3.5-35B-A3B,展现出可与 Gemma4-31B 等大体量模型比肩的逻辑推理与智能体协同能力。

作为一款全模态开源模型,Qwen3.6-35B-A3B 在空间智能与视觉感知方面同样表现优异,RefCOCO 评分高达92.0,部分多模态指标已比肩 Claude Sonnet4.5。目前,该模型已集成至 Qwen Studio,并通过阿里云百炼平台以 qwen3.6-flash 之名对外提供 API 服务,支持 preserve_thinking 思维链保留功能,能无缝适配 OpenClaw、Claude Code 及 Qwen Code 等主流 AI 编程助手。

随着端侧 AI 与自动化智能体需求的激增,Qwen3.6-35B-A3B 的开源不仅为开发者提供了高性能的低功耗选项,更预示着“小参数、高智能”的 MoE 模型正成为重塑编程范式与多模态交互的新基石。